Les IA ne naissent pas intelligentes

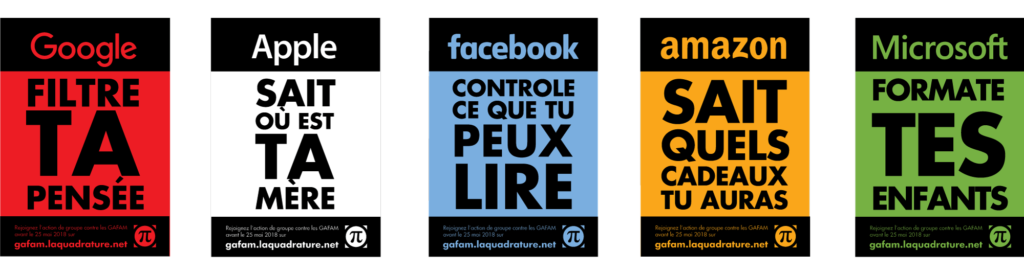

Dans le cadre de la mise en application de la RGPD, nous avons relayé sur notre site web une campagne courageuse de l’association française « La quadrature du net » visant à sensibiliser la population des risques que font planer les GAFAM sur notre société.

Les pratiques de chacun des GAFAM ci-dessus sont analysées sous l’angle de la nouvelle RGPD et de leur éthique sous-jacente. L’article concernant Microsoft est particulièrement représentatif des problèmes graves que ces géants du numériques génèrent.

Nous reproduisons ici l’intégralité de l’article d’Antonio Casili, ainsi que le reportage vidéo sur la dresseuse d’IA.

Les humains derrière Cortana, par Antonio Casilli

Antonio Casilli, membre de La Quadrature du Net, est chercheur à l’EHESS et maître de conférence à Télécom ParisTech (voir son site).

Qui écoute vos conversations quand vous utilisez un assistant vocal comme Cortana ? Qui regarde vos requêtes quand vous utilisez un moteur de recherche comme Bing ? « Personne », vous assurent les concepteurs de ces dispositifs, « ce sont des machines ». La réalité est tout autre, comme l’atteste ce témoignage : une jeune femme qui, sans contrat de travail et sans aucun accord de confidentialité, a retranscrit des milliers de conversations privées, recherches d’information, noms et coordonnées personnelles de personnes utilisant des produits Microsoft.

Son métier ? Dresseuse d’IA.

Malgré les allégations de leurs producteurs, les assistants virtuels qui équipent les enceintes connectées trônant dans nos salles à manger ou qui se nichent jusque dans nos poches, installés sur nos smartphones, ne naissent pas intelligents. Ils doivent apprendre à interpréter les requêtes et les habitudes de leurs utilisateurs.

Cet apprentissage est aidé par des êtres humains, qui vérifient la pertinence des réponses des assistants virtuels aux questions de leurs propriétaires. Mais plus souvent encore, ces êtres humains « entraînent » les dispositifs, en leurs fournissant des données déjà préparées, des requêtes avec des réponses toutes faites (ex. « Quelle est la météo aujourd’hui ? » : « Il fait 23 degrés » ou « Il pleut »), des phrases desquelles ils fournissent des interprétations (ex. savoir dans quel contexte « la flotte » signifie « un ensemble de navires » ou « la pluie »).

Ces dresseurs d’intelligences artificielles sont parfois des télétravailleurs payés à l’heure par des entreprises spécialisées. Dans d’autres cas, ils sont des « travailleurs à la pièce » recrutés sur des services web que l’on appelle des plateformes de micro-travail.

Celle de Microsoft s’appelle UHRS et propose des rémunérations de 3, 2, voire même 1 centime de dollar par micro-tâche (retranscrire un mot, labelliser une image…). Parfois les personnes qui trient vos requêtes, regardent vos photos, écoutent vos propos sont situés dans votre pays, voire dans votre ville (peut-être vos voisins d’en bas ?). D’autres fois, ils sont des travailleurs précaires de pays francophones, comme la Tunisie, le Maroc ou le Madagascar (qui s’est dernièrement imposé comme « leader français de l’intelligence artificielle »

Les logiciels à activation vocale tels Cortana, Siri ou Alexa sont des agents conversationnels qui possèdent une forte composante de travail non-artificiel. Cette implication humaine introduit des risques sociétaux spécifiques. La confidentialité des données personnelles utilisées pour entraîner les solutions intelligentes est à risque. Ces IA présupposent le transfert de quantités importantes de données à caractère personnel et existent dans une zone grise légale et éthique.

Dans la mesure où les usagers des services numériques ignorent la présence d’êtres humains dans les coulisses de l’IA, ils sous-estiment les risques qui pèsent sur leur vie privée. Il est urgent de répertorier les atteintes à la privacy et à la confidentialité associées à cette forme de « digital labor », afin d’en estimer la portée pour informer, sensibiliser, et mieux protéger les personnes les plus exposées.